A pesar de que su nombre podría parecer intimidante, las redes neuronales no tienen un concepto demasiado complicado detrás de ellas. El nombre, como podrás imaginar, viene de la idea de imitar el funcionamiento de las redes neuronales de los organismos vivos: un conjunto de neuronas conectadas entre sí y que trabajan en conjunto, sin que haya una tarea concreta para cada una. Con la experiencia, las neuronas van creando y reforzando ciertas conexiones para "aprender" algo que se queda fijo en el tejido.

Todas las redes neuronales artificiales se basan en una idea sencilla: dados unos parámetros hay una forma de combinarlos para predecir un cierto resultado.

Ahora bien, dentro del estudio de las redes neuronales (RN) existen diversos tipos o arquitecturas que, dependiendo de su configuración, nos ayudan a realizar ciertas tareas. Muchas de estas arquitecturas han sido inspiradas en organismos vivos: por ejemplo, tenemos las redes neuronales convolucionales, que han ayudado a dar saltos enormes en campos como el computo de visión.

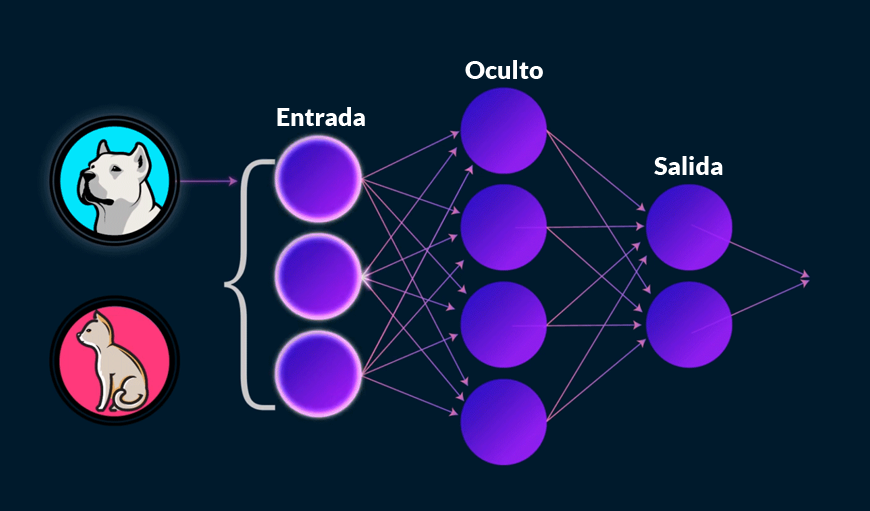

Vamos a ver rápidamente cómo funcionan; las redes neuronales calculan correlaciones de correlaciones. Tienen al menos 3 capas: entrada, oculta y salida.

- La capa de entrada captura un dato en cada nodo y lo copia a todas las neuronas de la capa oculta.

- Las neuronas de la capa oculta calculan una suma ponderada de todas las señales de la capa de entrada, cada una usando sus propios coeficientes o pesos.

- Las salidas de la capa oculta pasan por una función no lineal de normalización y el proceso se repite para la capa de salida.

El problema aparece cuando la capa de entrada es muy grande: los cálculos crecen en forma geométrica.

La retina del ojo resuelve el problema con un truco ingenioso: las células de la retina son como la capa de entrada, cada una equivalente a un pixel de imagen. Sobre la retina hay una red de ganglios neuronales, cada uno conectado a un racimo de células.

En vez de procesar cada “pixel” como una RN normal, los ganglios calculan un “resumen” de la información visual de su grupo de células. Este resumen es la convolución de todos los niveles de luz de los pixeles, y una función de filtro o kernel, calibrada para destacar bordes. De esta forma, el cerebro comprime las áreas de la imagen que no contienen información importante como, por ejemplo, el espacio en blanco a la izquierda de esta página.

Las redes neuronales que imitan la retina se llaman redes neuronales convolucionales. La función kernel se diseña para que responda con un resultado mayor a ciertos rasgos de interés en la imagen. Por ejemplo, si el kernel calcula la diferencia entre el brillo de un pixel y su vecino, la magnitud de la convolución va a ser mayor en las áreas de bordes o contrastes fuertes (diferencia mayor), y menor en las áreas sin contrastes (diferencia cero).

R&D Chief Scientist

Perfil LinkedIn